La comprensión de los modelos de lenguaje de gran tamaño (LLMs, por sus siglas en inglés) ha sido un tema de debate en el ámbito tecnológico. A pesar de los avances significativos en inteligencia artificial, estos modelos siguen siendo uno de los terrenos más inexplorados. Anthropic ha introducido una técnica innovadora denominada circuit tracing, que les ha permitido desentrañar algunos de los mecanismos internos de su modelo Claude 3.5 Haiku.

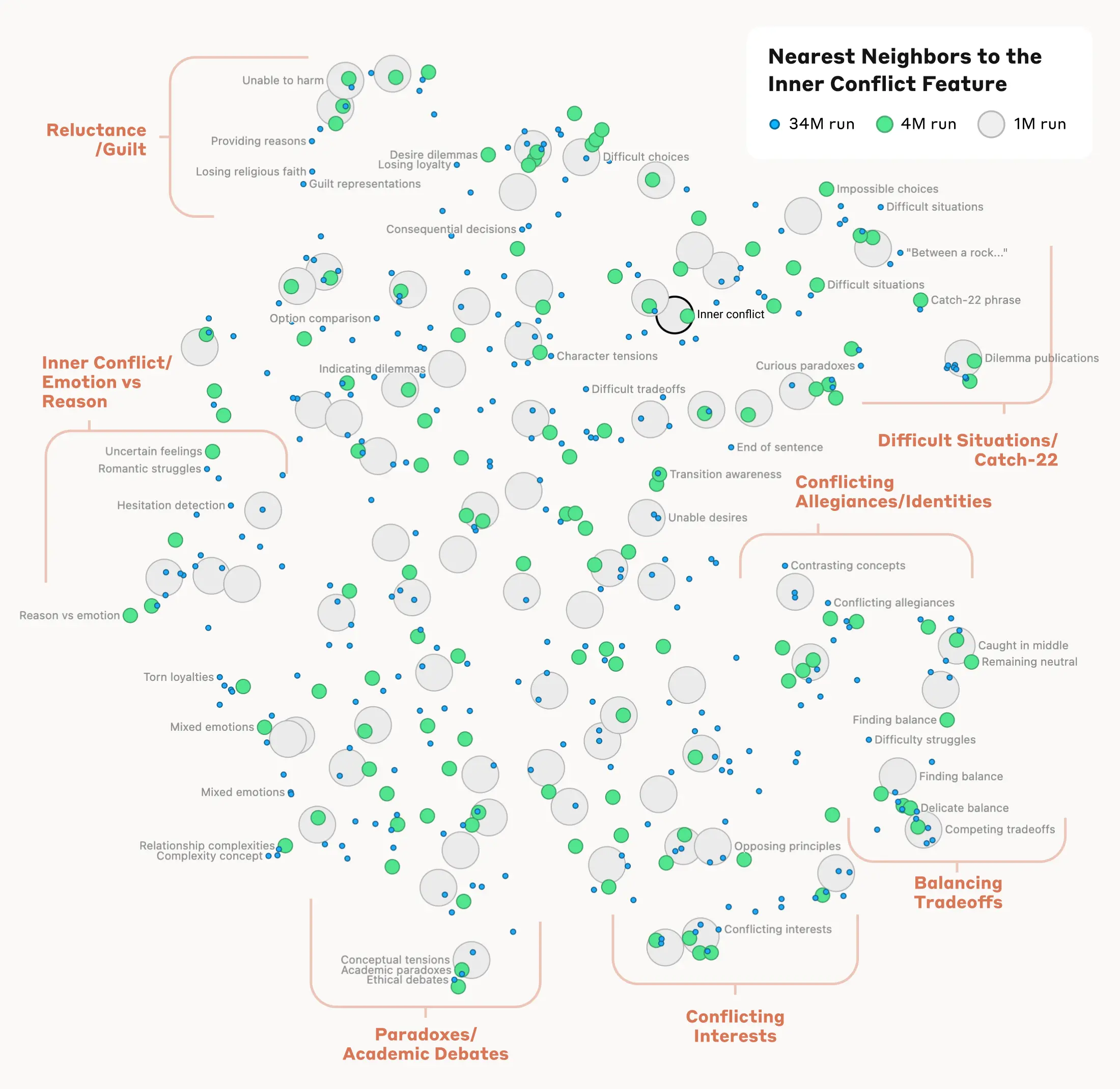

El circuit tracing es un método que permite a los investigadores seguir cómo un modelo de IA construye sus respuestas paso a paso, similar a seguir el cableado en un cerebro humano. Anthropic utilizó esta técnica para investigar diez comportamientos distintos de Claude, de los cuales tres destacaron por su singularidad.

Uno de los ejemplos analizados fue la respuesta a la pregunta «¿Cuál es el opuesto de pequeño?». A pesar de lo que podría esperarse, Claude no utiliza componentes separados para cada idioma. En lugar de eso, primero determina la respuesta usando circuitos neutrales al idioma y luego elige las palabras adecuadas para el idioma de la pregunta. Este proceso indica que Claude no simplemente memoriza traducciones, sino que aplica conceptos abstractos de manera similar a como lo haría un ser humano.

El aspecto matemático del modelo también revela su peculiaridad. Cuando se le pide sumar 36 y 59, Claude no sigue el método tradicional. En cambio, empieza a aproximar sumando «40 y 60» o «57 y 36», acabando en un «92». Otra parte del modelo identifica que la respuesta debe terminar en 5. Al combinar estos razonamientos inusuales, Claude llega a la respuesta final de 95.

La creación poética de Claude es aún más intrigante. Cuando se le pidió que escribiera un pareado con el inicio «Vio una zanahoria y tuvo que agarrarla», el modelo decidió la palabra «conejo» como la que rima con «agarrarla», y luego formuló la línea final: «Su hambre era como la de un conejo hambriento». Esto sugiere que los LLMs pueden tener más previsibilidad y planificación de lo que se suponía, ya que no se limitan a predecir una palabra tras otra para formar una respuesta coherente.

Joshua Batson, un científico investigador de Anthropic, señala que lo descubierto hasta ahora es solo «la punta del iceberg». La trazabilidad de una única respuesta puede llevar horas y aún queda mucho por descubrir sobre el funcionamiento de estos modelos.